Modelos1

-

Upload

michael-reynolds -

Category

Documents

-

view

1 -

download

0

description

Transcript of Modelos1

UNIVERSIDAD DE ORIENTENÚCLEO DE MONAGAS

PROGRAMA DE INGENIERÍA DE SISTEMASMODELOS OPERACIONALES I

MATURÍN / MONAGAS / VENEZUELA

PROFESOR:Cristhian Ronceros

REALIZADO POR:Arnia DanaysDomador CristinaGrillet DiegoMarcano AndreaMedina SusanPalma RosmarVéliz Luisa

MATURÍN, JULIO 2012

PROGRAMACIÓN NO LINEAL

Optimización no lineal sin restricciones

Uno de los principales campos de la programación no lineal es el de la optimización no restringida u optimización libre, que trata el problema de minimizar o maximizar una función en ausencia de cualquier restricción. Existen métodos de búsqueda del valor óptimo de una función f(x) que pueden ser aplicados para funciones de una ó varias variables, usando derivadas o sin usar derivadas.

Métodos de búsqueda

La idea de los métodos de búsqueda directa es identificar el intervalo de incertidumbre que comprenda al punto de solución óptima. El procedimiento localiza el óptimo estrechando en forma progresiva el intervalo de incertidumbre hasta cualquier grado de exactitud que se desee.

Se presentan dos algoritmos estrechamente relacionados:

Métodos de búsqueda dicótomo Método de la sección dorada. Ambos buscan la maximización de una función unimodal f(x) en el intervalo a ≤ x ≤ b, que se sabe que incluye el punto óptimo x*.

Optimización no lineal sin restricciones

Métodos de búsqueda para la optimización de funciones unimodales en problemas no restringidos

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

Paso general i. Sea II-1= (XL, XR) el intervalo actual de incertidumbre (en la iteración 0, XL = X1 y XR = X2). A continuación se definen X1 y X2 tales que

XL < X1 < X2 < XR

Una medida de la efectividad de los métodos de búsqueda de puntos óptimos en funciones unimodales de una sola variable es la siguiente:

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

El siguiente intervalo de incertidumbre, Ii, se define como:

Si F(X1) >F(X2), entonces XL < X* < X2. Se define XR= X2 e Ii = (XL,X2)

Si F(X1) <F(X2), entonces X1 < X* < XR. Se define XL= X1 e Ii = (X1,XR)

Si F(X1) =F(X2), entonces X1 < X* < X2. Se define XL= X1 , XR= X2 e Ii = (X1,X2)

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

La manera en que se determinan X1 y X2 garantiza que Ii < Ii – 1, como se demostrará en breve. El algoritmo termina en la iteración k si Ik ≤ ∆, donde ∆ es un grado de exactitud definido por el usuario.

Donde, este valor se conoce como la Razón Dorada y permite encontrar de forma eficiente el óptimo.

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

Ejemplo:

Determine el máximo valor de la siguiente función, suponga que ∆ = 0.1. :

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

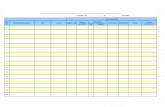

La siguiente tabla muestra los cálculos para las iteraciones 1 y 2;

Iteración 1:

Si F(X1) <F(X2), entonces X1 < X* < XR. Se define XL= X1 e Ii = (X1,XR)

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

La siguiente tabla muestra los cálculos para las iteraciones 1 y 2;

Iteración 2:

Si F(X1) <F(X2), entonces X1 < X* < XR. Se define XL= X1 e Ii = (X1,XR)

Optimización no lineal sin restricciones

Método de búsqueda de la sección del Oro

Cálculo del Error:

La metodología de las técnicas de optimización no lineal para funciones sin usar derivadas consistía en establecer un método que cambie el valor de la función objetivo hacia la dirección del máximo ó mínimo, para los métodos que utilizan derivadas las cuestiones básicas de metodología son las mismas.

Métodos que utilizan derivadas

Optimización no lineal de funciones de varias variables sin restricciones

El método de Newton hace uso de la aproximación de segundo orden de la función utilizando las derivadas segundas con respecto a cada una de las variables independientes. De esta forma es posible tener en cuenta la curvatura de la función en el punto e identificar las mejores direcciones de búsqueda.

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Algoritmo de Newton:

1. Función diferenciable dos veces f(x) y un valor inicial X0.

2. Calcular la gradiante y el Hessiano (matriz hessiana definida positiva).

3. Aplicar la ecuación:

4. Repetir todos los anteriores (iterar).

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Ejemplo: Dada la función f1(X1,X2)= 10X1^2+X2^2 y un punto inicial X0=(1,2)T, calcular el mínimo utilizando el algoritmo de Newton.

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

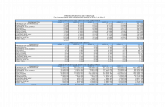

Cálculo del gradiente:

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Cálculo del Hessiano:

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Cálculo del Hessiano:

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Cálculo del Hessiano:

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Cálculo del Hessiano:

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Calculo del Hessiano

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Cálculo del Hessiano:

Inverso del Hessiano:

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Evaluar el punto inicial en la gradiente y en la función:

Para K = 0

Método de Newton

Optimización no lineal de funciones de varias variables sin restricciones

Resultado:

1. La programación no lineal tiene la limitante de la no existencia de un algoritmo único para cualquier problema no lineal, tal como el Método Simplex.

2. Muchos de los problemas de programación no lineal requieren de software de computadora, para alcanzar su solución completa, tal como el paquete GINO, aunque, entre más pequeño sea el error permisible (E) es mejor su aproximación al punto óptimo.

3. Los métodos de solución de programación no lineal se pueden clasificar en términos generales como procedimientos directos o indirectos. Los métodos directos son los algoritmos de gradiente, donde el máximo(mínimo) de un problema se busca siguiendo la tasa de incremento(disminución) mas rápida de la función objetivo en un punto. En los métodos indirectos, el problema original se transforma primero en un problema auxiliar del cual se determina el óptimo.

Gracias por su atención