autorregresion

-

Upload

jaime-contreras -

Category

Documents

-

view

308 -

download

6

Transcript of autorregresion

12-1

Introducción a las series temporales y

Predicción

(SW Capítulo 12)

Los datos de series temporales son datos recogidos en la

misma unidad de observación en múltiples períodos de

tiempo

• Consumo agregado y PIB de un país (por ejemplo, 20

años de observaciones trimestrales = 80

observaciones)

• Tipos de cambio Yen/$, Libra/$ y Euro/$ (datos

diarios de un año = 365 observaciones)

• Consumo de cigarrillos per capita en un estado

12-2

Ejemplo #1 de datos de series temporales: tasa de

inflación en EE.UU

12-3

Ejemplo #2: Tasa de desempleo en EE.UU

12-4

¿Por qué usar datos de series temporales?

• Para desarrollar modelos de predicción

o ¿Cuál será la tasa de inflación el próximo año?

• Para estimar efectos causales dinámicos

o Si la Reserva Federal incrementa los tipos de los

fondos del tesoro ahora, ¿cuál será el efecto en las

tasas de inflación y desempleo dentro de 3 meses? ¿Y

dentro de 12 meses?

o ¿Cuál es el efecto a lo largo del tiempo sobre el

consumo de cigarrillos de un incremento continuado

en el impuesto de los cigarrillos?

• Además, algunas veces no tenemos otra opción …

o Las tasas de inflación y desempleo en EE.UU. sólo se

pueden observar en el tiempo.

12-5

Los datos de series temporales dan lugar a nuevos resultados

técnicos

• Retardos temporales

• Correlación a lo largo del tiempo (correlación serial o

autocorrelación)

• Modelos de predicción que no tienen una interpretación

causal (Herramientas especializadas para predicción):

o Modelos autorregresivos (AR)

o Modelos autorregresivos de retardos distribuidos

(ADL)

• Condiciones bajo las cuales los efectos dinámicos pueden

estimarse, y cómo estimarlos

• Cálculo de los errores estándar cuando los errores

presentan correlación serial

12-6

Uso de los modelos de regresión para predicción

(SW Sección 12.1)

• La predicción y la estimación de efectos causales son

objetivos algo diferentes.

• Para predicción,

o 2R es importante (¡muy importante!)

o ¡El sesgo de variable omitida no es un problema!

o No nos preocuparemos de la interpretación de los

coeficientes en los modelos de predicción

o La validación externa es fundamental: el modelo

estimado utilizando datos históricos debe

mantenerse en el futuro (próximo)

12-7

Introducción a los datos de series temporales y

correlación serial

(SW Sección 12.2)

Primero debemos introducir algo de notación y de

terminología

Notación para los datos de series temporales

• Yt = valor de Y en el período t.

• Conjunto de datos: Y1,…,YT = T observaciones de la serie

temporal de la variable aleatoria Y

• Sólo consideramos observaciones consecutivas,

igualmente espaciadas (por ejemplo, mensuales, 1960 a

1999, sin meses “pérdidos”) (todavía más

complicaciones...)

12-8

Transformaremos las variables de series temporales

utilizando retardos, primeras diferencias, logarítmos,

& tasas de crecimiento

12-9

12-10

Ejemplo: Tasa trimestral de inflación en una tasa anual

• IPC en el primer trimestre de 1999 (1999:I) = 164.87

• IPC en el Segundo trimestre de 1999 (1999:II) = 166.03

• Cambio porcentual en IPC, 1999:I a 1999:II

= 166.03 164.87

100164.87

− ×

= 1.16

100164.87

×

= 0.703%

• Cambio porcentual en IPC, 1999:I a 1999:II, a una tasa

anual = 4×0.703 = 2.81% (porcentaje por año)

• Como ocurre con los tipos de interés, las tasas de inflación se

proporcionan (a modo de convención) como tasa anual (es decir,

siempre se habla de la tasa de inflación anual, no de la tasa de

inflación trimestral)

• Usando la aproximación logarítmica de los cambios porcentuales

obtenemos 4×100×[log(166.03) – log(164.87)] = 2.80%

12-11

Ejemplo: Inflación de IPC en EE.UU – su primer retardo

y su cambio

IPC = Indice de Precios al Consumo (Bureau of Labor

Statistics)

12-12

12-13

Autocorrelación

La correlación de una serie con sus propios valores retardados

values se llama autocorrelación o correleción serial.

• La primera autocorrelación de Yt es corr(Yt,Yt–1)

• La primera autocovarianza de Yt es cov(Yt,Yt–1)

• Así

corr(Yt,Yt–1) = 1

1

cov( , )

var( ) var( )

t t

t t

Y Y

Y Y

−

−

=ρ1

• Estas son las correlaciones poblacionales – describen la

distribución conjunta poblacional de (Yt,Yt–1)

12-14

12-15

Autocorrelaciones Muestrales

La jésima autocorrelación muestral es un estimador de la

jésima autocorrelación poblacional:

ˆj

ρ = �

�

cov( , )

var( )

t t j

t

Y Y

Y

−

donde

�cov( , )t t jY Y − = 1, 1,

1

1( )( )

1

T

t j T t j T j

t j

Y Y Y YT j

+ − −

= +

− −− −

∑

donde 1,j TY + es la media muestral de Yt calculada sobre las

observaciones t = j+1,…,T

o Nota: el sumatorio va desde t=j+1 hasta T (¿por qué)?

12-16

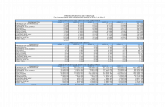

Ejemplo: Autocorrelaciones de:

(1) la tasa trimestral de inflación en EE.UU

(2) el cambio trimestre a trimestre en la tasa trimestral

de inflación

12-17

• La tasa de inflación presenta elevada correlación serial (ρ1 = .85)

• La tasa de inflación del último trimestre contiene mucha información sobre la

tasa de inflación actual (la tasa de inflación actual depende mucho de la tasa

anterior)

• El gráfico está dominado por oscilaciones dentro de cada año que se repiten

anualmente

• ¡Pero quedan aún movimientos sorprendentes!

12-18

Más ejemplos de series temporales & transformaciones

12-19

Más ejemplos de series temporales & transformaciones, ctd.

12-20

Estacionariedad: una idea central para la validez

externa de los modelos de series temporales

La estacionariedad dice que el pasado es como el presente

y el futuro, al menos en un sentido probabilístico.

Nos centraremos en el caso en el que Yt es estacionaria.

12-21

Autorregresiones

(SW Sección 12.3)

Un punto de partida natural para un modelo de predicción

es usar valores pasados de Y (es decir, Yt–1, Yt–2,…) para

predecir Yt.

• Una autorregresión es un modelo de regresión en el cual

se hace la regresión de Yt sobre sus propios valores

retardados.

• El número de retardos usados como regresores se llama el

orden de la autorregresión.

o En una autorregresión de primer orden, se hace la

regresión de Yt sobre Yt–1

12-22

o En una autorregresión de orden p, se hace la regresión

de Yt sobre Yt–1,Yt–2,…,Yt–p.

El modelo Autorregresivo de Primer Orden (AR(1))

El modelo AR(1) poblacional es

Yt = β0 + β1Yt–1 + ut

• β0 y β1 no tienen interpretación causal

• Si β1 = 0, Yt–1 no es útil para predecir Yt

• El modelo AR(1) puede estimarse aplicando MCO a la

regresión de Yt sobre Yt–1

12-23

• La contrastación de β1 = 0 v. β1 ≠ 0 genera un contraste

de la hipótesis de que Yt–1 no es útil para predecir Yt

12-24

Ejemplo: modelo AR(1) para el cambio en la inflación

Se estima usando datos desde 1962:I – 1999:IV:

�tInf∆ = 0.02 – 0.211∆Inft–1

2R = 0.04

(0.14) (0.106)

¿El cambio retardado en la inflación es un predictor útil del

cambio actual en la inflación?

• t = .211/.106 = 1.99 > 1.96

• ⇒Rechaza H0: β1 = 0 al nivel de significación del 5%

• Si, el cambio retardado en la inflación es un predictor útil

del cambio actual en la inflación (pero ¡el 2R es

reducido!)

12-25

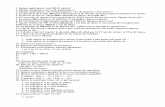

Ejemplo: modelo AR(1) para la inflación – STATA

Primero, hagamos que STATA conozca que estamos

trabajando con datos de series temporales

generate time=q(1959q1)+_n-1; _n es el no de observación.

Así este comando crea una nueva variable

tiempo que tiene un formato de fechas

trimestral especial

format time %tq; Especifica el formato de fechas trimestral

sort time; Ordena por tiempo

tsset time; Le dice a STATA que la variable tiempo

es la variable que quiero indicar la

escala temporal

12-26

Ejemplo: Modelo AR(1) para la inflación – STATA, ctd.

. gen lcpi = log(cpi); la variable ipc ya está en memoria

. gen inf = 400*(lcpi[_n]-lcpi[_n-1]); la tasa trimestral de inflación en

tasa anual

. corrgram inf , noplot lags(8); calcula las 8 primeras autocrrelaciones

muestrales

LAG AC PAC Q Prob>Q

-----------------------------------------

1 0.8459 0.8466 116.64 0.0000

2 0.7663 0.1742 212.97 0.0000

3 0.7646 0.3188 309.48 0.0000

4 0.6705 -0.2218 384.18 0.0000

5 0.5914 0.0023 442.67 0.0000

6 0.5538 -0.0231 494.29 0.0000

7 0.4739 -0.0740 532.33 0.0000

8 0.3670 -0.1698 555.3 0.0000

. gen inf = 400*(lipc[_n]-lipc[_n-1])

Esta sentencia crea una nueva variable, inf, la “n-ésima” observación de

las cuales es 400 veces la diferencia entre la n-ésima observación de lipc

y la “n-ésima-1” observación de lipc, es decir, la primera diferencia de

lipc

12-27

Ejemplo: modelo AR(1) para la inflación – STATA, ctd

Sintaxis: L.dinf es el primer retardo de dinf

. reg dinf L.dinf if tin(1962q1,1999q4), r;

Regression with robust standard errors Number of obs = 152

F( 1, 150) = 3.96

Prob > F = 0.0484

R-squared = 0.0446

Root MSE = 1.6619

------------------------------------------------------------------------------

| Robust

dinf | Coef. Std. Err. t P>|t| [95% Conf. Interval]

-------------+----------------------------------------------------------------

dinf |

L1 | -.2109525 .1059828 -1.99 0.048 -.4203645 -.0015404

_cons | .0188171 .1350643 0.14 0.889 -.2480572 .2856914

------------------------------------------------------------------------------

if tin(1962q1,1999q4)

sintaxis de STATA para series temporales para utilizar únicamente las

observaciones comprendidas entre 1962q1 y 1999q4 (ambas inclusive).

Esto requiere definir primero la escala temporal, como se hizo antes

12-28

Predicciones y errores de predicción

Una nota sobre terminología:

• Un valor predicho (ajustado) se refiere al valor de Y

predicho (ajustado utilizando una regresión) para una

observación dentro de la muestra utilizada para estimar

la regresión – esta es la definición usual

• Una predicción se refiere al valor Y predicho para una

observación que no está en la muestra utilizada para

estimar la regresión

• Valores predichos son “dentro de la muestra”

• Predicciones son predicciones del futuro – que no han

sido usados para estimar la regresión.

12-29

Predicciones: notación

• Yt|t–1 = predicción de Yt basada en Yt–1,Yt–2,…,

utilizando los coeficientes poblacionales desconocidos

(verdaderamente desconocidos)

• | 1ˆt tY − = predicción de Yt basada en Yt–1,Yt–2,…,

utilizando los coeficientes estimados, que fueron

estimados utilizando datos hasta el período t–1.

Para un AR(1),

• Yt|t–1 = β0 + β1Yt–1

• | 1ˆt tY − = 0β̂ + 1β̂ Yt–1, donde 0β̂ y 1β̂ se estimaron

utilizando datos hasta el período t–1.

12-30

Errores de predicción

El error de predicción un período hacia adelante es,

Error de predicción = Yt – | 1ˆt tY −

La diferencia entre un error de predicción y un residuo es

la misma que entre un valor predicho (ajustado) y una

predicción:

• un residuo es “dentro de la muestra”

• un error de predicción es “fuera de la muestra” – el

valor de Yt no se utiliza en la estimación de los

coeficientes de regresión

12-31

El error de predicción cuadrático medio (RMSFE)

RMSFE = 2

| 1ˆ[( ) ]t t tE Y Y −−

• El RMSFE es una medida de la escala de la

distribución del error de predicción.

• El RMSFE es como la desviación estándar de ut,

excepto por el hecho de que explícitamente se centra

en el error de predicción usando coeficientes

estimados, no utilizando la recta de regresión

poblacional.

• El RMSFE es una medida de la magnitud de un típico

“error” de la predicción

12-32

Ejemplo: Predicción de la inflación utilizando un AR(1)

El AR(1) se estima usando los datos desde 1962:I a

1999:IV:

�tInf∆ = 0.02 – 0.211∆Inft–1

Inf1999:III = 2.8 (las unidades son porcentajes, a una tasa

anual)

Inf1999:IV = 3.2

∆Inf1999:IV = 0.4

De manera que la predicción de ∆Inf2000:I es,

�2000: |1999:I IVInf∆ = 0.02 – 0.211×0.4 = -0.06 ≈ -0.1

12-33

Así

�2000: |1999:I IVInf = Inf1999:IV + � 2000: |1999:I IVInf∆ = 3.2 – 0.1 = 3.1

El modelo autorregresivo de orden p (AR(p))

Yt = β0 + β1Yt–1 + β2Yt–2 + … + βpYt–p + ut

• El modelo AR(p) utiliza p retardos de Y como regresores

• El modelo AR(1) es un caso especial

• Los coeficientes no tienen una interpretación causal

• Para contrastar la hipótesis de que Yt–2,…,Yt–p no ayudan

demasiado a predecir Yt, más allá de Yt–1, se utiliza un test F

• Se utilizan tests t- F- para determinar el orden del retardo p

• O, mejor, determinar p utilizando un “criterio de información”

(ver SW Sección 12.5 – no cubriremos esto aquí)

12-34

Ejemplo: modelo AR(4) para la inflación

�tInf∆ = .02 – .21∆Inft–1 – .32∆Inft–2 + .19∆Inft–3

(.12) (.10) (.09) (.09)

– .04∆Inft–4, 2

R = 0.21

(.10)

• El estadístico F para contrastar los retardos 2, 3, 4 es

6.43 (p-valor < .001)

• 2R se incrementa desde .04 hasta .21 añadiendo los

retardos 2, 3 y 4

• Los retardos 2, 3, 4 (conjuntamente) ayudan a predecir

el cambio en la inflación, por encima y más allá del

primer retardo

12-35

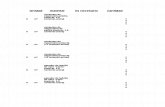

Ejemplo: modelo AR(4) para la inflación – STATA

. reg dinf L(1/4).dinf if tin(1962q1,1999q4), r;

Regression with robust standard errors Number of obs = 152

F( 4, 147) = 6.79

Prob > F = 0.0000

R-squared = 0.2073

Root MSE = 1.5292

------------------------------------------------------------------------------

| Robust

dinf | Coef. Std. Err. t P>|t| [95% Conf. Interval]

-------------+----------------------------------------------------------------

dinf |

L1 | -.2078575 .09923 -2.09 0.038 -.4039592 -.0117558

L2 | -.3161319 .0869203 -3.64 0.000 -.4879068 -.144357

L3 | .1939669 .0847119 2.29 0.023 .0265565 .3613774

L4 | -.0356774 .0994384 -0.36 0.720 -.2321909 .1608361

_cons | .0237543 .1239214 0.19 0.848 -.2211434 .268652

------------------------------------------------------------------------------

NOTES

• L(1/4).dinf es una forma conveniente de decir “usa los retardos 1–4 de dinf como regresores”

• L1,…,L4 se refieren al primer, segundo,… 4th retardos de dinf

12-36

Ejemplo: modelo AR(4) para la inflación – STATA, ctd.

. dis "Adjusted Rsquared = " _result(8); el resultado(8) es el R2 corregido Adjusted Rsquared = .18576822 de la regresión más reciente

. test L2.dinf L3.dinf L4.dinf; L2.dinf es el segundo retardo de dinf,etc.

( 1) L2.dinf = 0.0

( 2) L3.dinf = 0.0

( 3) L4.dinf = 0.0

F( 3, 147) = 6.43

Prob > F = 0.0004

Nota: algunas de las características de STATA para

series temporales difieren de STATA v. 7 y STATA v.

8…

12-37

Disgresión: usamos ∆Inf, no Inf, en los AR’s. Por qué?

El modelo AR(1) de Inft–1 es un modelo AR(2) para Inft:

∆Inft = β0 + β1∆Inft–1 + ut

ó

Inft – Inft–1 = β0 + β1(Inft–1 – Inft–2) + ut

ó

Inft = Inft–1 + β0 + β1Inft–1 – β1Inft–2 + ut

De manera que

Inft = β0 + (1+β1)Inft–1 – β1Inft–2 + ut

Entonces, por qué usar ∆Inft, y no Inft?

12-38

Modelo AR(1) de ∆Inf: ∆Inft = β0 + β1∆Inft–1 + ut

Modelo AR(2) de Inf: Inft = γ0 + γ1Inft + γ2Inft–1 + vt

• Cuando Yt tiene fuerte correlación serial, el estimador MCO de

los coeficientes AR está sesgado hacia cero.

• En el caso extremo en el que el coeficiente AR = 1, Yt no es

estacionario: los ut’s se acumulan e Yt se amplia.

• Si Yt no es estacionaria, la teoría de regresión con la que estamos

trabajando aquí fracasa

• Aquí, Inft tiene fuerte correlación serial – de manera que para

mantenernos dentro de un esquema de trabajo que

comprendamos, las regresiones se especifican utilizando ∆Inf

• Como lecturas opcionales, véase SW Sección 12.6, 14.3, 14.4

12-39

Modelos de series temporales con predictores

adicionales y el modelo de retardos distribuidos

(ADL)

(SW Sección 12.4)

• Hasta ahora, hemos considerado modelos de predicción que

sólo utilizan los valores pasados de Y

• Parece razonable añadir otras variables (X) que pueden ser

útiles como predictores de Y, más allá de los valores

predichos de los valores retardados de Y:

Yt = β0 + β1Yt–1 + … + βpYt–p

+ δ1Xt–1 + … + δrXt–r + ut

• Este es un modelo autorregresivo de retardos distribuidos

(ADL)

12-40

Ejemplo: desempleo retardado e inflación

• La “curva de Phillips” dice que si el desempleo se encuentra

por encima de su tasa de equilibrio ó tasa “natural”,

entonces la tasa de inflación se incrementará.

• Es decir, ∆Inft debería relacionarse con valores retardados

de la tasa de desempleo, con coeficiente negativo

• La tasa de desempleo a la cual la inflación ni se incrementa

ni disminuye se llama a menudo “tasa de no aceleración de

inflación tasa de desempleo”: la NAIRU

• ¿Se encuentra esta relación para los datos de la economía de

EE.UU?

• ¿Se puede explotar esta relación para predecir la inflación?

12-41

La “Curva de Phillips” empírica

El NAIRU es el valor de u para el cual ∆Inf = 0

12-42

Ejemplo: modelo ADL(4,4) para la inflación

�tInf∆ = 1.32 – .36∆Inft–1 – .34∆Inft–2 + .07∆Inft–3 – .03∆Inft–4

(.47) (.09) (.10) (.08) (.09)

–2.68Desemt–1 + 3.43Desemt–2 – 1.04Desemt–3 + .07Desemt–4

(.47) (.89) (.89) (.44)

• 2R = 0.35 – significativa mejora en comparación con

el AR(4), para el cual 2R = .21

12-43

Ejemplo: dinf y desem – STATA

. reg dinf L(1/4).dinf L(1/4).unem if tin(1962q1,1999q4), r;

Regression with robust standard errors Number of obs = 152

F( 8, 143) = 7.99

Prob > F = 0.0000

R-squared = 0.3802

Root MSE = 1.371

------------------------------------------------------------------------------

| Robust

dinf | Coef. Std. Err. t P>|t| [95% Conf. Interval]

-------------+----------------------------------------------------------------

dinf |

L1 | -.3629871 .0926338 -3.92 0.000 -.5460956 -.1798786

L2 | -.3432017 .100821 -3.40 0.001 -.5424937 -.1439096

L3 | .0724654 .0848729 0.85 0.395 -.0953022 .240233

L4 | -.0346026 .0868321 -0.40 0.691 -.2062428 .1370377

unem |

L1 | -2.683394 .4723554 -5.68 0.000 -3.617095 -1.749692

L2 | 3.432282 .889191 3.86 0.000 1.674625 5.189939

L3 | -1.039755 .8901759 -1.17 0.245 -2.799358 .719849

L4 | .0720316 .4420668 0.16 0.871 -.8017984 .9458615

_cons | 1.317834 .4704011 2.80 0.006 .3879961 2.247672

------------------------------------------------------------------------------

12-44

Ejemplo: modelo ADL(4,4) para la inflación – STATA, ctd.

. dis "Adjusted Rsquared = " _result(8);

Adjusted Rsquared = .34548812

. test L2.dinf L3.dinf L4.dinf;

( 1) L2.dinf = 0.0

( 2) L3.dinf = 0.0

( 3) L4.dinf = 0.0

F( 3, 143) = 4.93 Los retardos extra de dinf son signif.

Prob > F = 0.0028

. test L1.unem L2.unem L3.unem L4.unem;

( 1) L.unem = 0.0

( 2) L2.unem = 0.0

( 3) L3.unem = 0.0

( 4) L4.unem = 0.0

F( 4, 143) = 8.51 Los retardos de unem son significativos

Prob > F = 0.0000

La hipótesis nula de que los coeficientes de los retardos de la tasa de

desempleo son todos cero se rechaza al nivel de significación del 1%

utilizando el estadístico F

12-45

El contraste de la hipótesis conjunta de que ninguna de las X’s

es un predictor útil, más allá y por encima de los valores

retardados de Y, se llama Test de causalidad de Granger

“causalidad” no es un término muy afortunado aquí: la

Causalidad de Granger simplemente se refiere a

contenido predictivo (marginal).

12-46

Resumen: Modelos de Predicción de Series

Temporales

• Si los objetivos son de predicción, ¡no es importante

tener coeficientes con interpretación causal!

• Se pueden producir predicciones simples y veraces

utilizando modelos AR(p) – estas son predicciones

que sirven de base para realizar comparaciones con

modelos de predicción mucho más complicados

• Se pueden añadir predictores adicionales (X’s); siendo

el modelo resultante un modelo autorregresivo de

retardos distribuidos (ADL)

12-47

• La estacionariedad significa que los modelos pueden

utilizarse fuera del rango de los datos utilizados para

estimar

• Ahora tenemos las herramientas necesarias para

estimar efectos causales dinámicos...