r78550

Click here to load reader

-

Upload

axell-oseguera -

Category

Documents

-

view

28 -

download

3

Transcript of r78550

Ciencia & Trabajo | AÑO 9 | NÚMERO 23 | ENERO / MARZO 2007 | www.cienciaytrabajo.cl | 39/41 39

Modelos de Regresión y Correlación II. Regresión Lineal MúltipleREGRESSION MODELS AND CORRELATION II. MULTIPLE LINEAR REGRESIÓN

Artículo de Educación

INTRODUCCIÓN

Continuando con el artículo de educación del número anterior deCiencia & Trabajo, revisaremos los principales aspectos delmétodo de regresión lineal múltiple. Es recomendable haber leídopreviamente el artículo mencionado.La regresión lineal múltiple es una técnica que intenta modelarprobabilísticamente el valor esperado de una variable Y, a partirde los valores de dos o más predictores. Es un método muy pode-roso y ampliamente utilizado en investigación (Canavos 1988)para:• Determinar la posibilidad de predecir a través de una expresión

muy simple el valor de la respuesta de interés, a partir de losvalores observados de una serie de factores (por ejemplo: riesgode silicosis, a partir de edad, tiempo trabajando expuesto asílice, uso de elementos de protección, etc.). ¿Son los predictorespropuestos adecuados para modelar en forma lineal la respuestade interés?

• Determinar la importancia relativa de la asociación lineal entrela respuesta y un predictor respecto a la asociación entre ellay otro predictor. ¿Cuáles de los predictores propuestos son loseficaces para modelar la respuesta en forma sencilla?

• Estimar la relación lineal entre los predictores y la variablerespuesta a partir de nuestros datos: ¿Cuál sería el modelolineal que recomendaríamos más adecuado, sencillo, pero rela-tivamente preciso?

La regresión lineal múltiple es matemáticamente similar a laregresión lineal simple (Taucher 1997, Polit y Hungler 2000),tomando la siguiente forma:

Y = β0 + β1*X1 + β2*X2 + … + βp*Xp + e (1)

Donde:Y Variable respuestaβ0 Interceptoβ1 Pendiente del predictor X1β2 Pendiente del predictor X2βp Pendiente del predictor Xpe Parte de la variabilidad de la respuesta correspondiente a unperfil dado de los predictores no explicada por el conjunto de losdistintos predictores; parte aleatoria del modelo de regresiónmúltiple.

El método de estimación de parámetros es equivalente al modelode regresión lineal simple (Salinas y Silva 2007), pero en estecaso se realiza a través de matrices. El detalle de la estimaciónmediante matrices es relativamente complejo y escapa a los obje-tivos de este artículo de educación, por lo cual no será revisado.

Correspondencia / Correspondence:Mauricio Salinas F.Fundación Científica y Tecnológica ACHSDiagonal Paraguay 29, piso 4, SantiagoTel.: (56-2) 685 29 61e-mail: [email protected]: 17 de Enero de 2007 / Aceptado 30 de Enero de 2007

Mauricio Salinas F1, Claudio Silva Z2

1. MD, Magister, Master en Salud Pública, Mención Salud Ocupacional (c)Director Unidad de Epidemiología y Estadística, Fundación Científica y Tecnológica ACHS.

2. PhD Estadística. Escuela de Salud Pública, Universidad de Chile.

RESUMENContinuando con la serie dedicada a Regresión y Correlación, en esteartículo se revisa la técnica de regresión lineal múltiple, explicandocómo opera y cuándo se utiliza. Se analiza un ejemplo utilizando elSoftware Epi Info, detallando la información entregada por elprograma, cuál es su explicación y cómo se interpreta. Se explicacómo introducir variables categóricas en el modelo de regresión linealmúltiple mediante la creación de variables dummy. Finalmente, seexplica la importancia de revisar los supuestos del modelo y asegurarun tamaño de muestra adecuado para que la estimación decoeficientes del modelo sea correcta.

(Salinas M, Silva C. 2007. Modelos de Regresión y Correlación II.Regresión Lineal Múltiple. Cienc Trab, Ene-Mar.;9 (23):39-41)

Descriptores: MODELOS LINEALES, REPRODUCIBILIDAD DE RESUL-TADOS, ANÁLISIS DE REGRESIÓN.

ABSTRACTContinuing the series dedicated to Regression and Correlation, thisarticle reviews the multiple linear regression technique, explaininghow it operates and when it is used. An example is analysed usingEpi Info Software, detailing the information provided by theprogram, its explanation and how it is interpreted. An explanationis given on how to introduce categorical variables in the multiplelinear regression model by creating dummy variables. Finally, anexplanation is provided on the importance of reviewing theassumptions of the model and insure a sample size adequate for theestimation of the model coefficients to be correct.

Keywords: LINEAR MODELS; REPRODUCIBILITY OF RESULTS,REGRESSION ANALYSIS.

40 39/41 | www.cienciaytrabajo.cl | AÑO 9 | NÚMERO 23 | ENERO / MARZO 2007 | Ciencia & Trabajo

ponde al Coeficiente de Determinación; el coeficiente de correla-ción es la raíz cuadrada de éste).Por último, tenemos una tabla donde se presentan los valores dela suma y media de cuadrados, los grados de libertad (g.l.) y laestadística F. Las distintas pruebas de significación que se pueden aplicar enmodelos de regresión las veremos en otro capítulo de esta serie,así que por el momento no analizaremos la estadística F, y sóloutilizaremos el valor–p obtenido.Como se explicó en el artículo sobre regresión lineal simple, paracada punto de la muestra tenemos asociados tres valores:Σ (y – y)2: Corresponde a la variabilidad total de la respuesta PAShallada en la muestra, sin prestar atención a la relación que ellapueda tener con el predictor Edad. En el ejemplo corresponde alvalor 3874,632.

Σ (y – y )2: Se asocia a la ganancia en “variabilidad explicada” alpasar nosotros de un modelo elemental que prediga para todaslas edades (xi ) el mismo valor y de PAS, a otro y que toma encuenta la influencia lineal que Edad parece tener sobre PAS. Éstaes la variabilidad que está siendo explicada por el modelo deregresión y en este caso equivale a 1959,484.

Σ (y – y)2: Se asocia a las diferencias entre cada PAS observada(y) y la predicha (y) por el modelo de regresión lineal simple apartir de la información Edad. Es la variabilidad de Y=PAS noatribuible a las diferencias en Edad y se llama Residuo. El valorde la suma de cuadrados de los 19 residuos es 1915,148.

Si dividimos la suma de cuadrados del modelo sobre la total, esdecir 1959,484/3874,32, obtenemos el valor del coeficiente dedeterminación: 0,506 (r2)El método para realizar pruebas de significación lo veremos enotro capítulo, así que, por el momento, podemos concluir losiguiente de la información entregada respecto a la Edad:1. Tiene una asociación positiva con la PAS, ya que la pendientemuestral (el coeficiente 1,275) es de signo positivo.2. La asociación es estadísticamente significativa, de acuerdo anuestra definición previa: valor–p de la edad 0,001.3. El r2 es 0,51, es decir, la edad explica el 51% de la variabilidadde PAS, en nuestra muestra.

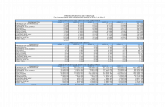

Veamos ahora la relación entre PAS y Peso. El Epi Info nosentregará:Podemos ver que el peso es también un predictor estadística-

mente significativo de la PAS, con un p value de 0,02. El pesologra explicar, de acuerdo a nuestros datos, el 28% de la variabi-lidad total de la PAS.

Artículo Original | Salinas Mauricio

Los cálculos y valores de los estimadores que se requieren en losejemplos siguientes se pueden obtener mediante el programa EpiInfo, de distribución gratuita y que se puede descargar en ladirección de Internet www.cdc.gov/epiinfo/.

A continuación analizaremos un ejemplo. Tenemos los siguientes datos obtenidos de una muestra aleatoriade 19 individuos, en relación a Presión Arterial Sistólica (PAS),edad y peso.

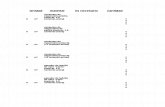

Tabla 1.Presión Arterial Sistólica, Edad y Peso para una muestra de 19 individuos..

Id Presión Arterial Sistólica Edad Peso(mmHg) (años) (Kg)

1 118 35 892 140 37 763 130 25 774 125 20 715 137 40 896 114 28 807 105 23 758 139 39 859 154 38 8610 128 30 8111 111 20 7512 119 23 7313 160 45 9014 131 48 9115 127 37 9016 119 31 8317 130 33 8218 142 38 8419 149 38 90

Analicemos primero la relación entre la variable respuesta PASy Edad mediante una regresión lineal simple. Definiremos comosignificativa una relación con un valor-p menor a 0,05, que esuna convención muy frecuente.Una vez digitados los datos en Epi Info, pedimos se estime apartir de ellos una regresión lineal y obtenemos lo siguiente:

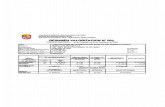

La primera tabla nos muestra el coeficiente asociado a la edad,es decir, el valor de la pendiente (los valores β de la fórmula 1),el error estándar, el valor de la estadística F y su p-valueasociado.Después aparece el coeficiente de determinación (r2) ya explicadoen el capítulo anterior (Silva y Salinas 2007). (El Epi Info loinforma por error como “Correlation Coeficient”, ya que corres-

Variable Coeficiente Error Estándar F Valor-P

EDAD 1,275 0,306 17,3936 0,001INTERCEPTO 88,272 10,396 72,1004 0,000

Coeficiente de Determinación: r2= 0.51

gl Suma de Cuadrados Cuadrado Medio F

Modelo 1 1959,484 1959,484 17.394Residuo 17 1915,148 112,656Total 18 3874,632

Variable Coeficiente Error Estándar F Valor-P

PESO 1,193 0,464 6,6221 0,020INTERCEPTO 32,001 38,358 0,6960 0,416

Coeficiente de Determinación: r2= 0.28

gl Suma de Cuadrados Cuadrado Medio F

Modelo 1 1086,198 1086,198 6,622Residuo 17 2788,434 164,026Total 18 3874,632

Ciencia & Trabajo | AÑO 9 | NÚMERO 23 | ENERO / MARZO 2007 | www.cienciaytrabajo.cl | 39/41 41

Artículo Original | Modelos de Regresión y Correlación II. Regresión Lineal Múltiple

Considerando que tanto la Edad como el Peso son predictores dela PAS, podemos considerar utilizarlas en conjunto. Esto nospermitiría:

Mejorar nuestra predicción.Disminuir el error o residuo del modelo.Cuantificar la importancia de cada predictor en conjunto.

Entonces, procedemos a estimar un modelo que contiene los dospredictores obteniendo lo siguiente:

Al generar un modelo combinado, podemos ver que la Edadcontinúa siendo un predictor estadísticamente significativo, noasí el Peso. Esto quiere decir que la Edad logra una predicciónbuena y mejor que la del Peso; la predicción de la Edad no lograser mejorada por la adición del Peso al modelo. De hecho, el r2

del modelo PAS vs. Edad es 0,51, apenas menor que el r2 de estemodelo (0,54).

UTILIZACIÓN DE VARIABLES CUALITATIVAS

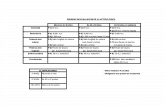

Frecuentemente, al utilizar regresión lineal múltiple, parece dese-able tener en consideración una o más variables cualitativas(nominales u ordinales). Cuando se utiliza una variable que tienedos categorías posibles (sexo, por ejemplo), ella es ingresada enel modelo e interpretada de igual forma que las variables cuanti-tativas, pero llevándola a valores binarios 0 y 1.Cuando se trata de una variable categórica X que tiene tres cate-gorías, deberemos reemplazarla por variables binarias (valores 1y 0), cuyas combinaciones identificarán inequívocamente las 3

categorías en cuestión. Analicemos el ejemplo de la Tabla 2,donde tenemos una variable predictora “Color de Ojos” que tienetres categorías.

En este caso hemos creado tres variables binarias, denominadasS1, S2 y S3 que permiten introducir la variable en el modelo deregresión. S1 representa el color de ojos verde; S2 el color de ojosazul y S3 el color de ojos marrón.Generalmente se introducen dos de estas variables en el modelo(S1 y S2, por ejemplo) y se deja una de ellas como valor de refe-rencia (S3, por ejemplo). Este tipo de variables binarias sonllamadas variables dummy. Para variables categóricas con más de tres niveles, se opera de lamisma forma. En general, una variable categórica de k nivelesdeberá representarse mediante k-1 variables binarias.

SUPUESTOS

El modelo de regresión lineal múltiple requiere que se satisfaganbásicamente los mismos supuestos que el modelo de regresiónlineal simple. Como se planteó en el primer artículo de esta serie,tales supuestos deben ser verificados en cada situación problemapara no provocar errores de modelación de la información reci-bida (Gujarati 1997).Otro punto importante a tener en cuenta si se desea generar unmodelo de regresión múltiple es el tamaño (n) de la muestra.Mientras más predictores se quiera incorporar en el modelomayor será el valor de n necesario para poder estimar eficiente-mente los coeficientes de la regresión. En forma muy gruesa,podemos decir que se requiere al menos 10 observaciones porcada predictor en el modelo. Sin embargo, existen métodos espe-cíficos para estimar el tamaño muestral adecuado en el estudiode un modelo de regresión.

Variable Coeficiente Error Estándar F Valor-P

EDAD 1,853 0,619 8,9693 0,009PESO -0,834 0,777 1,1494 0,301INTERCEPTO 137,934 47,465 8,4451 0,011

Coeficiente de Determinación: r2= 0.54

gl Suma de Cuadrados Cuadrado Medio F

Modelo 2 2087,843 1043,922 9,348Residuo 16 1786,788 111,674Total 18 3874,632

Tabla 2.Ejemplo de creación de variables binarias para la variable categórica“Color de Ojos”.

COLOR DE OJOS S1 S2 S3

Verde 1 0 0Azul 0 1 0Marrón 0 0 1

Canavos G. 1988. Análisis de regresión: el modelo lineal simple. En:Probabilidad y estadística: aplicaciones y métodos. 1a ed. México: Mc Graw-Hill. p. 443-502.

Gujarati D. 1997. Econometría. 3a ed. Colombia: Mc Graw Hill.Polit D, Hungler B, eds. 2000. Procedimientos estadísticos multivariados. En:

Investigación Científica en Ciencias de la Salud. 6a ed. México: Mc GrawHill. p. 485 – 520.

Silva C, Salinas M. 2007. Modelos de Regresión y Correlación. Revista CiencTrab, Oct – Dic; 8 (22). 185 – 9.

Taucher E. 1997. Bioestadística. 1a ed. Santiago: Editorial Universitaria.

REFERENCIAS